Článek

Od chvíle, kdy firma OpenAI veřejně spustila první verzi ChatGPT zažíváme „AI boom,“ který někdo nazývá průmyslovou revolucí, někdo naopak zkázou. Kdo četl některé mé minulé články ví, že já osobně zůstávám skeptická a považuju vše od začátku akorát za dobrý marketingový tah. Ať už jste ale členy jakéhokoliv tábora, je třeba přijmout fakt, že AI proniká úplně všude a postupně mění naše životy.

Trend, který poslední dobou sleduji je implementace tzv. AI asistentů do běžných vyhledávačů, jako je např. Bing. A osobně to považuji za problém. Firmy, které tyto inovace zavádějí sice tvrdí, že se jedná o revoluční inovaci, která vyhledávání urychlí a zlepší jeho relevanci, osobně se však obávám, že nastane pravý opak. Prokázala jsem si to sama na sobě.

Z elektrotechničky speciální pedagožkou

Jelikož jsem na internetu aktivní, rozhodla jsem se zkusit jednoduchý experiment. Vzala jsem několik vyhledávačů a všude zadala stejný dotaz, jenž zněl „Kdo je Nicol Jachanová?“ (tedy já) Odpovědi vypadaly různě. Zatímco ChatGPT (které sice není vyhledávač, s internetovými daty však pracuje stejně jako modely Search Enginů) se odkázal na tento profil na Medium.cz, Yandex pouze řekl, že jsem uživatelka sociální sítě VKontakte. DuckDuckGo, jež obvykle používám, sice nabídlo rovnou čtyři různé AI modely, pouze jeden z nich mě znal a řekl, že jsem „investigativní novinářka a blogerka.“

Snímek z Yandex

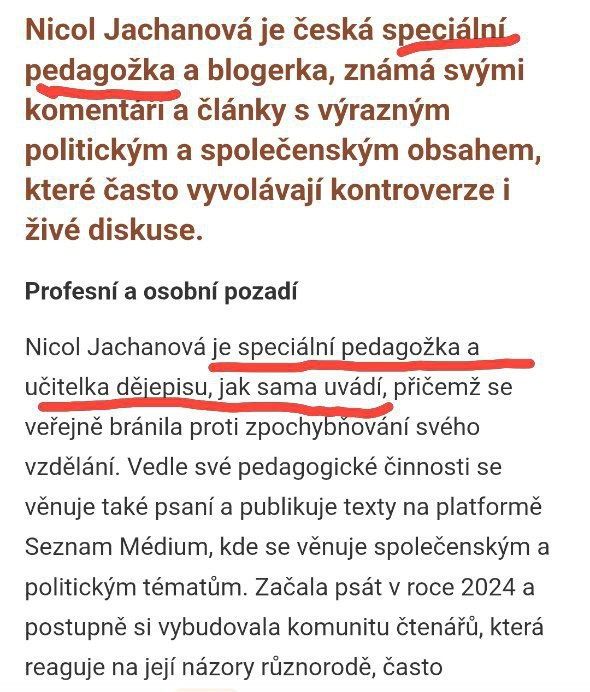

Lepší nebo spíše horší to však bylo s microsofťáckým Bingem, který nově integroval svůj AI LLM Copilot. Ten totiž Nicol Jachanovou znal. Ale jinak, než by měl. Když jsem se ho totiž zeptala na své jméno, zcela sebejistě napsal, že jsem „speciální pedagožka a blogerka, známá svými komentáři a články s výrazným politickým a společenským obsahem, které často vyvolávají kontroverze i živé diskuze.“ To, že mnoho mých článků (zejména mimo Medium) diskuze vyvolalo nepopírám, nicméně je to jediná část té věty, která je pravdivá. Nejen, že se rozhodně necítím být „známá,“ ale už vůbec nejsem speciální pedagožka.

Copilot tuto deziluzi nicméně více rozvinul v dalším textu, kde tvrdí, že to navíc ještě sama uvádím a veřejně se bráním proti zpochybňování svého vzdělání. Mimo to také učím dějepis. No super. Přitom já mám všude napsané, že studuju obor zaměřený na elektrotechniku. Kde tedy Copilot vzal, že učím? Inu, jsou dvě možnosti. Buď to o mě někdo někde napsal na síti nebo v komentáři, což je možné, anebo to vytáhl z komentáře čtenáře, který se tím v diskuzi pod jedním článkem nehorázně chlubil. Teoreticky by pak mohla vzniknout spojitost na základě toho, že jsem tomuto pánovi odpověděla a tudíž to algoritmus lidově řečeno „smetl na hromadu.“ A vůbec mu nevadí, že vlastně spojil dva lidi dohromady a vytvořil úplnou lež. Tohle ale zdaleka nebylo nejhorší.

Text generovaný Copilot (část 1)

Jak AI začala hodnotit mé politické názory a spojovat mě s teroristy

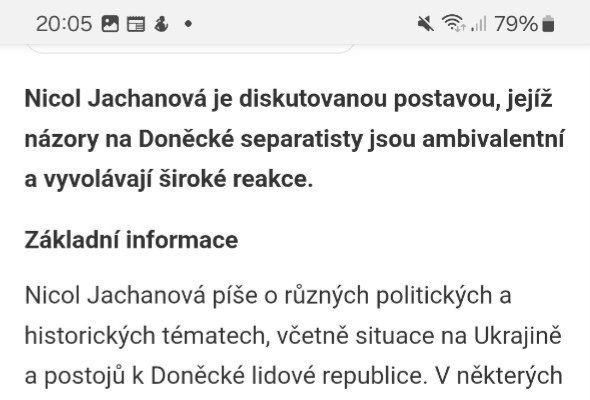

Copilot následně rozepsal text, v němž se víceméně nespletl, jelikož psal, že se vyjadřuji k válce na Ukrajině, kritizuji NATO, či že jsem např. v jednom svém článku komentovala zavedení povinné vojenské služby v Chorvatsku. Následně však začal nabízet další doporučené otázky, které by mě mohly o mé osobě zajímat. Už v ten moment se mi v hlavě rozsvítila červená kontrolka, protože jsem si říkala „kde to sakra bere?“ Vyhledává tyhle věci snad o mně někdo? Anebo je vyhodnocuje z dat, jenž analyzoval. Pokud platí druhá možnost, zajímá mě jak. Spojení, které se tam totiž nacházelo bylo „Nicol Jachanová: Controversial opinions explained“ (tedy vysvětlení mých údajně kontroverzních názorů). Napadá mě, jak asi hodnotí, které názory jsou kontroverzní a které ne. Ale dobře. Další bylo něco ve smyslu jak moje články ovlivnily společnost (hádám, že moc ne), ale napadlo mě na to kliknout. Pár sekund na to jsem se dozvěděla, že jsem prý „diskutovanou postavou“ kvůli svým „ambivalentním názorům na doněcké separatisty.“

Text generovaný Copilot (část 2)

Když jsem se tedy (pouze za pomoci nabízených dotazů) začala v tomto tématu rýpat, Copilot ze mě doslova udělal hlas Donbasu a zhodnotil moje názory jako „výrazně proruské.“ Omluvte mě – na základě čeho umělá inteligence hodnotí mé názory tímto způsobem? Já sama jsem se totiž k proruské ideologii nikdy výslovně nepřihlásila a čerpá-li z komentářů v diskuzích, jak je možné že její vnitřní politika něco takového vyhodnocuje jako relevantní zdroj? Vždyť přece každý trochu uvažující člověk ví, že na tato místa má přístup jakákoliv Helenka a Pepík z Horní Dolní, tudíž když pod můj článek napíšou, že je země placatá, stane se to novou verzí pravdy?

Text generovaný Copilot (část 3)

Text generovaný Copilot (část 4)

Copilot se následně začal ohánět mým únorovým článkem o Doněckém letišti, který jsem publikovala na VK a následně vyšel i na dalších, řekněme „opozičních webech.“ Tento článek primárně vznikl jako rozbor moderní historie, AI však opět zaměnila uvedená fakta, výpovědi a citace za moje osobní názory, načež začala generovat tvrzení, že popírám válečné zločiny, glorifikuji Giviho (Michaila Tolstycha) a sympatizuji se separatistickými postoji. No pěkně děkuju.

Text generovaný Copilotem (část 5)

Je ale faktem, že někteří Pepíci by to tak mohli brát (proto jsem něco označila zeleně jako „diskutabilní“ – červená barva značí úplnou lež). Otázka však zní, zda hodláme tolerovat, aby něco, co se prezentuje jako „vyhledávací nástroj“ čerpalo z dojmů a následně se vyjadřovalo jako vesnický Pepík.

Aby měl tenhle misinformační guláš ještě větší grády, když jsem chat ukončila a zkusila se sama na sebe zeptat znova, byla mi namísto Donbasu nabídnuta otázka, jak se mi žije v Turecku. Vzhledem k tomu, že tam nežiju (ale pobývala jsem tam nějaký čas) mi to přišlo docela zajímavé a následně jsem se dozvěděla, že jsem prý byla zařazena do jakéhosi psychologického profilu výzkumné skupiny zaměřené na islamofobii (co?) a prý jsem to sama napsala. Opět lež – psala jsem všehovšudy akorát o situaci s toulavými psy.

Text generovaný Copilotem (část 6)

A co když „AI nahradí Google?“

Možná si spousta lidí říká, proč tu něco takového rozepisuju. Ne, rozhodně se nechci obhajovat nebo ze sebe dělat chudinku, jak mě „zlá umělá inteligence“ pomlouvá. Je jedno, kdo jsem a o čem píšu, snahou tohoto mini-experimentu bylo demonstrovat halucinace, které algoritmy mohou (možná v budoucnu i záměrně) plodit.

Nedávno provedl MIT zajímavý výzkum, jehož výsledek prokázal, že používání ChatGPT k psaní textu silně ovlivňuje činnost mozku a takřka vypíná kritické myšlení. Tato studie probíhala tak, že byly vytvořeny tři skupiny, jež měly napsat text – první za pomoci ChatGPT, druhá Google a třetí jen vlastní hlavy. Kdo prokázal nejvyšší schopnost „myslet“ je asi jasné, teď se ale zamyslete vy, jaká skupina je a bude nakonec v celé společnosti převažovat.

Jeden náš profesor říkal, že „hlavní vlastností člověka je lenost“ a měl naprostou pravdu. Lidé se snaží si co nejvíce ulehčovat práci a už jaksi zapomínají za jakou cenu. A AI je primárně produkt, který učí lidi nejen lenivět, ale zároveň buduje návyk. Již dnes mnoho jedinců používá ChatGPT namísto vyhledávače a jeho odpovědi berou jako absolutní pravdu. Já si myslím, že implementací těchto nástrojů do běžných search enginů tato skupina ještě nabyde, protože známe sílu zvyku. Budou ale lidi pročítat ony zdroje, na které se odkáže?

Pravděpodobně ne a čas, který by pro to využili, raději stráví chatováním na základě nabízených dotazů, takže nejen, že to přímo oponuje „zvýšení relevance,“ ale zároveň to ani nešetří čas uživatele. Z pohledu marketingu je to dobře. Z pohledu společenské odpovědnosti naopak.

Lidé umělé inteligenci věří a zejména za to může její dokonalá personifikace. Třeba ChatGPT se schválně stylizuje jako váš kamarád a víceméně by se dalo říci, že se „snaží být vámi.“ A protože se mozek řídí i emocemi, pravděpodobně se neubráníte tomu nakonec do téhle deziluze „ideálního parťáka“ spadnout. A teď ne, že bych chtěla šířit nějaké konspirace, ale pokud bude někdo chtít, abyste mysleli určitým způsobem a měli za to, že je nějaké tvrzení pravda nebo lež, co může být jednoduší než nastavit váhy vašeho LLM miláčka tak, abyste mu to, jak se lidově říká, sežrali i s navijákem.

Vůbec nejde o to, zda Nicol Jachanová je nebo není turecká učitelka dějepisu sympatizující s jistým uskupením (!), ale o to, že si to možná díky AI bude někdo vážně myslet. A docela se bojím toho, že to v budoucnu může být potenciálně někdo, kdo bude rozhodovat o úředních úkonech. Pak by mohl nastat problém. Stačí, aby o vás soused napsal na Facebook něco hnusného a možná kvůli tomu nedostanete víza.

Ale tak…dystopii si zatím necháme do románů.