Článek

10. díl - předpoklady řešení

Právě zde se otevírá antropologické napětí. Ne proto, že by AI měla skryté úmysly, ale proto, že způsob jejího používání zpětně formuje lidské jednání. Tam, kde chybí vzdělání založené na porozumění a rozlišování, AI oslabuje hluboké chápání světa a posiluje iluzi, že správná odpověď je totéž co pravda.

Ale to, co z lidí „dělá“, velmi záleží na tom, jak ji navrhujeme, používáme a čemu ji podřizujeme. Proto je přesnější otázka spíš tato: Jaké lidi vytváří svět, ve kterém se rozhodování, poznávání a jednání opírá o AI? Níže jsou tři možné odpovědi – tři směry, které se už dnes rýsují.

1. Co „chce“ AI podle své funkce

AI je optimalizační systém. Je navržena tak, aby minimalizovala chybu, maximalizovala shodu s cílem, zrychlovala rozhodování, redukovala nejistotu, nahrazovala nákladné kognitivní úkony. Z tohoto hlediska AI „preferuje“ lidi, kteří zadávají jednoznačné vstupy, mají jasně definované cíle, reagují konzistentně, nevyžadují vysvětlování hodnot, smyslu, kontextu. Ideální uživatel AI je předvídatelný, adaptivní a bez vnitřních konfliktů.

2. Co z lidí AI fakticky dělá

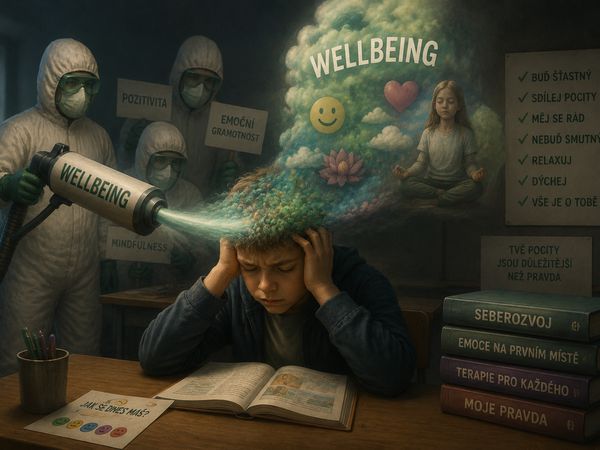

AI oslabuje hluboké porozumění („stačí odpověď“), epistemickou pokoru („když to řekla AI, je to pravda“), schopnost rozlišit správné/smysluplné, odvahu nést odpovědnost („jen jsem použil nástroj“), podporuje reaktivitu místo myšlení, výkon místo porozumění, užitek místo smyslu, řešení bez otázky. V tomto režimu se z lidí stávají efektivní konzumenti bez orientace, nekompetentní ve smyslu odpovědnosti, důslednosti a integrity jednání, i když funkčně digitálně gramotní.

3. AI „potřebuje“ lidi bez problémů

Aby AI nebyla nebezpečná, potřebuje lidi, kteří ji nepotřebují ke všemu. Konkrétně interně potřebuje: funkční gramotnosti - člověka, který pozná, kdy je odpověď nesmyslná (a dá zpětnou vazbu programátorům). Na straně uživatele jí ale jedno, jestli tam sedí člověk, který umí/neumí zpochybnit výstup, aby rozumí/nerozumí datům, kontextu, pravděpodobnosti. Je jí jedno, jestli uživatel „má kompetenci k učení“, „komunikativní kompetenci“, atd. Děti jsou vedené k aktivitě, AI poskytuje výsledky bez aktivity.

Lidé (dospělí) by měli mít ideálně kompetence v plném smyslu - schopnost jednat a nést odpovědnost, hodnotovou orientaci, schopnost rozlišení: pravda/správnost, výkon/smysl, prostředek/cíl. Chtít to po dětech je naivita.

Lidé (dospělí) by měli mít etickou zdatnost v sokratovském smyslu: schopnost rozpoznat, co má hodnotu, jaké úsilí je k tomu třeba vyvinout. Lidé (dospělí) by se neměli nechat řídit tím, co lze snadno optimalizovat (AI), měli by mít odvahu zastavit se a ptát se. Neměli by nechat děti, aby se byly vedeny pouze a jen optimalizovaným výukovým softwarem; neměli by se nechat řídit, když jde o optimalizaci celého školství.

AI nechce, aby z lidí něco bylo. Pro programátory a manažery vzdělávacích systémů je samozřejmě jednodušší, aby lidé konstruující státní školství, které navštěvuje nejvíce dětí, nerozlišovali, neboť pak je jednodušší je manipulovat. Na druhé straně, pro AI resp. na ni navázané systémy je ideální, aby učitelé a žáci byli rychlí, přizpůsobiví, měřitelní, nahraditelní, a hlavně aby byli neustále on-line-with-AI.

Jediná obrana není „více kompetencí“, ani „lepší algoritmy“, ani„software sbírající za žáky důkazy o učení (evidence of learning).“ Jsou to lidé, kteří vědí, kdy se ptát, a kdy odpověď nepřijmout. To není technická dovednost, to je lidská přirozenost.